Das Informatik-Team von der Universität Jena entwickelt robuste Modelle der künstlichen Intelligenz (KI), die eine automatisierte Bildanalyse und Artbestimmung von Nachtfaltern und anderen Insekten ermöglichen. Diese KI-Modelle werden die Bilder der Kamera-Lichtfallen des Projektes effizient verarbeiten und die erfassten Nachtfalter zuverlässig bestimmen. Dies ist eine Herausforderung, denn es handelt sich um mehr als 1100 Arten von Großschmetterlingen und sogar um mehr als 4000 Arten von nachtaktiven Faltern insgesamt in Deutschland. Das Team von Paul Bodesheim in der Computer Vision Group wird dabei verschiedene Formen von Wissen, beispielsweise durch die biologische Taxonomie oder Größeneigenschaften der Falter, in maschinelle Lernverfahren integrieren, um eine hohe Genauigkeit bei der Artbestimmung zu erzielen.

Die KI-Modelle bauen auf Vorarbeiten zur Erkennung von Nachtfalterarten im Verbundvorhaben AMMOD auf. Die Artbestimmungen der KI-Modelle werden in einer Datenbank gespeichert und bilden die Grundlage für umfangreiche Datenanalysen zur Biodiversität und zu Veränderungen der Artenvielfalt. Darüber hinaus sollen die KI-Verfahren dabei unterstützen, annotierte Trainingsdaten zu beschaffen, indem den Nutzern des Bestimmungssystems Vorschläge unterbreitet werden. Wir setzen auch Gamification-Ansätze für spielerisches Annotieren mit KI-Unterstützung um. Die Entwicklungen der KI-Modelle in diesem Projekt haben einen starken Einfluss auf die Grundlagenforschung im Bereich der visuellen Artbestimmung. Auch sind sie für den Aufbau der Monitoring-Datenbank und der Datenanalyse zu Veränderungen der Artenvielfalt wichtig.

Tiefe Lernverfahren und künstliche neuronale Netze

Die entwickelten KI-Modelle verwenden tiefe Lernverfahren (engl. deep learning) des maschinellen Lernens, welche seit über 10 Jahren Stand der Technik auf diesem Gebiet sind und den größten Anteil in der aktuellen KI-Forschung ausmachen. Diese modernen Lernverfahren ermöglichen in Kombination mit großen Mengen an Beispieldaten zum Trainieren eines Vorhersage-Modells enorme Leistungsfähigkeiten für anspruchsvolle Erkennungsaufgaben in den Bereichen Bild- und Spracherkennung, was sich auch in einer Vielzahl von „intelligenten“ Apps widerspiegelt, die heutzutage fast alle im Umgang mit Smartphones bewusst oder unbewusst nutzen. Grundlage bilden künstliche neuronale Netze, die in der Lage sind, Informationen aus Bildern oder Texten durch eine Verkettung von einer Vielzahl mathematischer Rechenoperationen zu extrahieren. Ein Bild wird durch eine Menge von Zahlen (Farbwerte eines jeden Pixels) repräsentiert und dient als Eingabe für die Berechnungen der mathematischen Funktionen, die das neuronale Netz repräsentiert. Jede einzelne Funktion kann durch Parameter beschrieben werden, deren Werte anhand riesiger Bilddatensätze und zugeordneten Beschriftungen (beispielsweise manuell bestimmte Insektenarten) ermittelt werden. Zum Lernerfolg tragen neben den großen Trainingsdatenmengen auch moderne Hardware und Rechencluster bei, die mit leistungsfähigen Grafikkarten ausgestattet sind und mehrere Berechnungen effizient und parallel ausführen können.

Insektenlokalisation im Bild

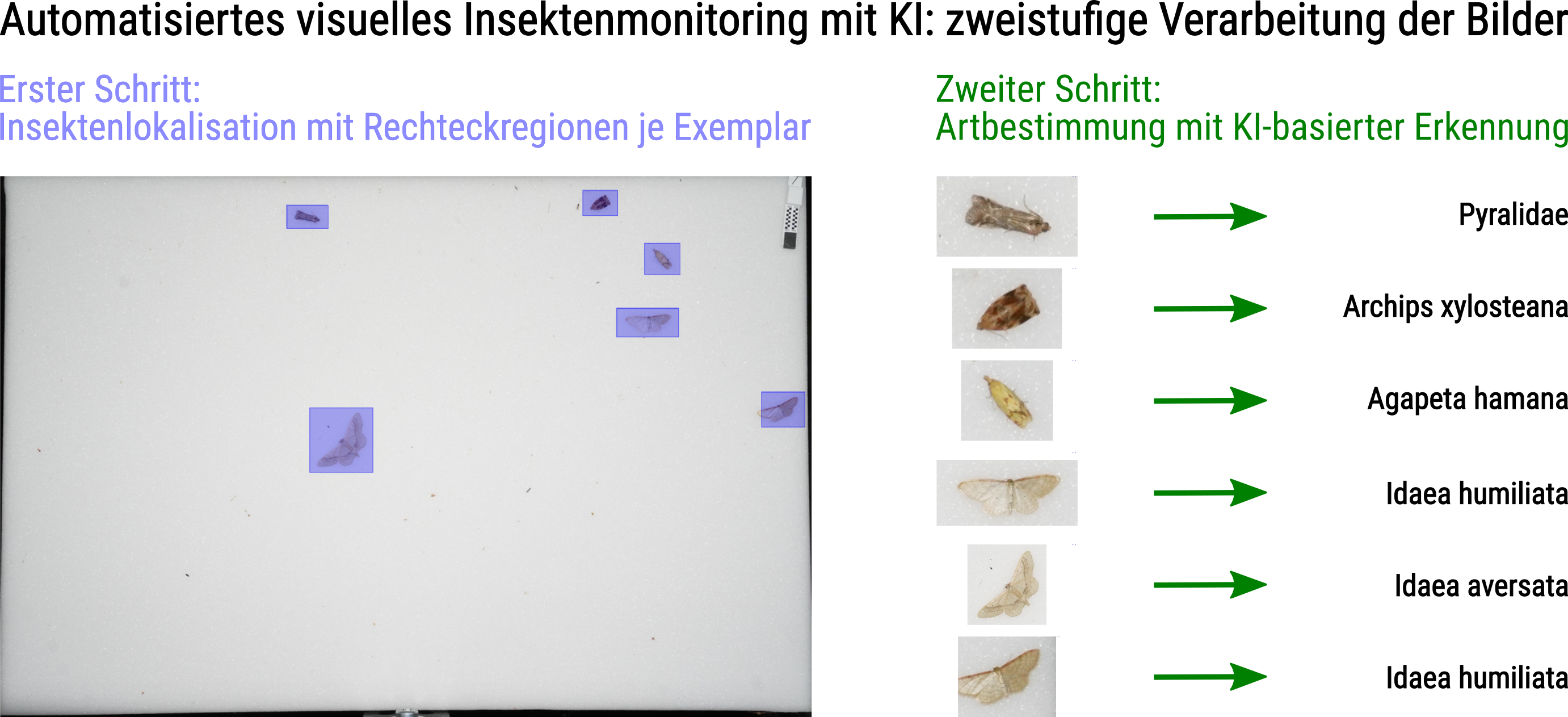

Der erste Schritt bei der automatisierten Verarbeitung der Kamerafallen-Bilder ist die Lokalisation einzelner Insekten. Damit ist für jedes erfasste Exemplar die Positionsbestimmung im Bild sowie die Erfassung der Größe in grober Näherung gemeint. Beides wird durch umschreibende Rechtecke (engl. bounding boxes) dargestellt und vom Rechner in Form einer Vordergrund-Hintergrund Unterscheidung ermittelt, wobei die Insekten als Objekte des Vordergrundes und alles andere als Hintergrund definiert ist. Da neben den Insekten auch andere „Objekte“ im Bild enthalten sein können (z.B. ein Maßstab zur Größenumrechnung in einer Ecke des Bildes, verschiedene Formen von Verschmutzungen der Schirmfläche durch Wind und Wetter), ist neben der Anwendung von Algorithmen der Bildverarbeitung und des Rechnersehens (engl. Computer Vision) auch der Einsatz von KI notwendig, damit das System Insekten von Nicht-Insekten (wie Maßstab, Blätter, Schmutzflecken) unterscheiden kann. Die Rechteckregionen haben den Vorteil, dass diese Bildausschnitte in der Folge als Teilbilder bzw. Einzelbilder kleinerer Größe weiterverarbeitet werden können, für die man eine eindeutige Zuordnung einer Art vornehmen kann. Durch die getrennte Betrachtung von Lokalisation der Insekten im Bild und Artbestimmung können unterschiedliche KI-Modelle für diese beiden unterschiedlichen Aufgaben unabhängig voneinander optimiert werden.

Artbestimmung mit KI

Für die visuelle Artbestimmung eines Insektes anhand eines einzigen Bildes (bzw. Bildausschnittes aus dem Bild einer Kamera-Falle) werden mit künstlich neuronalen Netzen charakteristische Merkmale extrahiert, die beispielsweise die Farbgebung und die Textur der Flügel durch Zahlenwerte numerisch beschreiben. Anhand dieser Werte erfolgt dann über Klassifikationsverfahren der Mustererkennung und des maschinellen Lernens die Zuordnung zu einer Klasse oder Kategorie, die in dem Fall von dem Begriff „Klasse“ aus der biologischen Taxonomie zu unterscheiden ist. Stattdessen entspricht jede Art einer Klasse oder einem Begriff, den man einem Bild(ausschnitt) zuordnen möchte.

Wissensintegration in KI-Modelle und Lernverfahren

Im Projekt LEPMON sollen verschiedene Formen von Zusatzwissen aus der Anwendung, sogenanntes Experten- oder Domänenwissen, in die KI-Modelle integriert werden, um die Artbestimmungen weiter zu verbessern und nicht nur aus den „reinen“ Pixelkonstellationen im Bild zu lernen.

Form- und Symmetriemerkmale

Nachtfalter unterscheiden sich beispielsweise sehr stark anhand ihrer Flügelformen, sodass man schon anhand der Silhouette eines Tieres bestimmte Arten bei der Bestimmung ausschließen kann. Sind die vorderen Flügel größer als die hinteren, entspricht die Form eher dem Buchstaben „V“, im umgedrehten Fall eher dem Buchstaben „A“. Diese Unterscheidungskriterien sollen explizit in die KI-Modelle integriert werden. Außerdem ist aus anderen Studien bekannt, dass bestimmte Arten stärker dazu neigen, sich mit geschlossenen Flügeln auf die Schirmfläche zu setzen, während andere Arten immer mit ausgebreiteten Flügeln „Platz nehmen“. Dies führt ebenfalls zu verschiedenen Umrissen und Konturen, die bei der automatisierten Bestimmung zum Tragen kommen sollen.

Größeninformationen und messbare Eigenschaften

Da in allen Bildern, die mit unseren Kamera-Lichtfallen aufgenommen werden, ein Maßstab enthalten ist, kann durch entsprechende Bildverarbeitungsmethoden eine automatische Umrechnung von Pixeln in Längeneinheiten (mm, cm) vorgenommen werden, sodass absolute Größen der Insekten aus den Bildern extrahiert werden können, was ohne Maßstab aufgrund unterschiedlicher Kameraentfernungen, Zoom-Stufen und Bildauflösungen nicht möglich wäre. Da jede Art im Erwachsenenstadium nur einen bestimmten Größenbereich abdeckt, können ebenfalls rein anhand der ermittelten Größen der Tiere bestimmte Arten von vornherein ausgeschlossen werden. Auch dies kann zu einer Verbesserung der Qualität bei der Artbestimmung beitragen und robuste Bestimmungsalgorithmen ermöglichen.

Taxonomie der Insekten

In der Entomologie ist bekannt, dass nicht für alle Insekten rein anhand visueller Bildmerkmale und Bildaufnahmen die Art eindeutig bestimmt werden kann. Für einige Arten sind dafür DNA-Analysen oder ähnliche, aufwendigere Laboruntersuchungen notwendig. Die KI muss mit dieser Unsicherheit bei der Bestimmung umgehen können und im Falle von nicht auflösbaren Mehrdeutigkeiten und Hinweisen, die für mehrere Arten als Kandidaten sprechen, eine sinnvolle und für nachfolgende Analysen geeignete Ausgabe liefern. Naheliegend ist in solchen Fällen, nicht die Art, sondern die Gattung oder Familie zurückzuliefern, also eine Bestimmung auf höherer taxonomischer Ebene. Zu diesem Zweck soll die zugrundeliegende Taxonomie der Insekten und die baumartigen, grafischen Abhängigkeiten zwischen Familien, Gattungen und Arten in die KI-Modelle integriert werden.